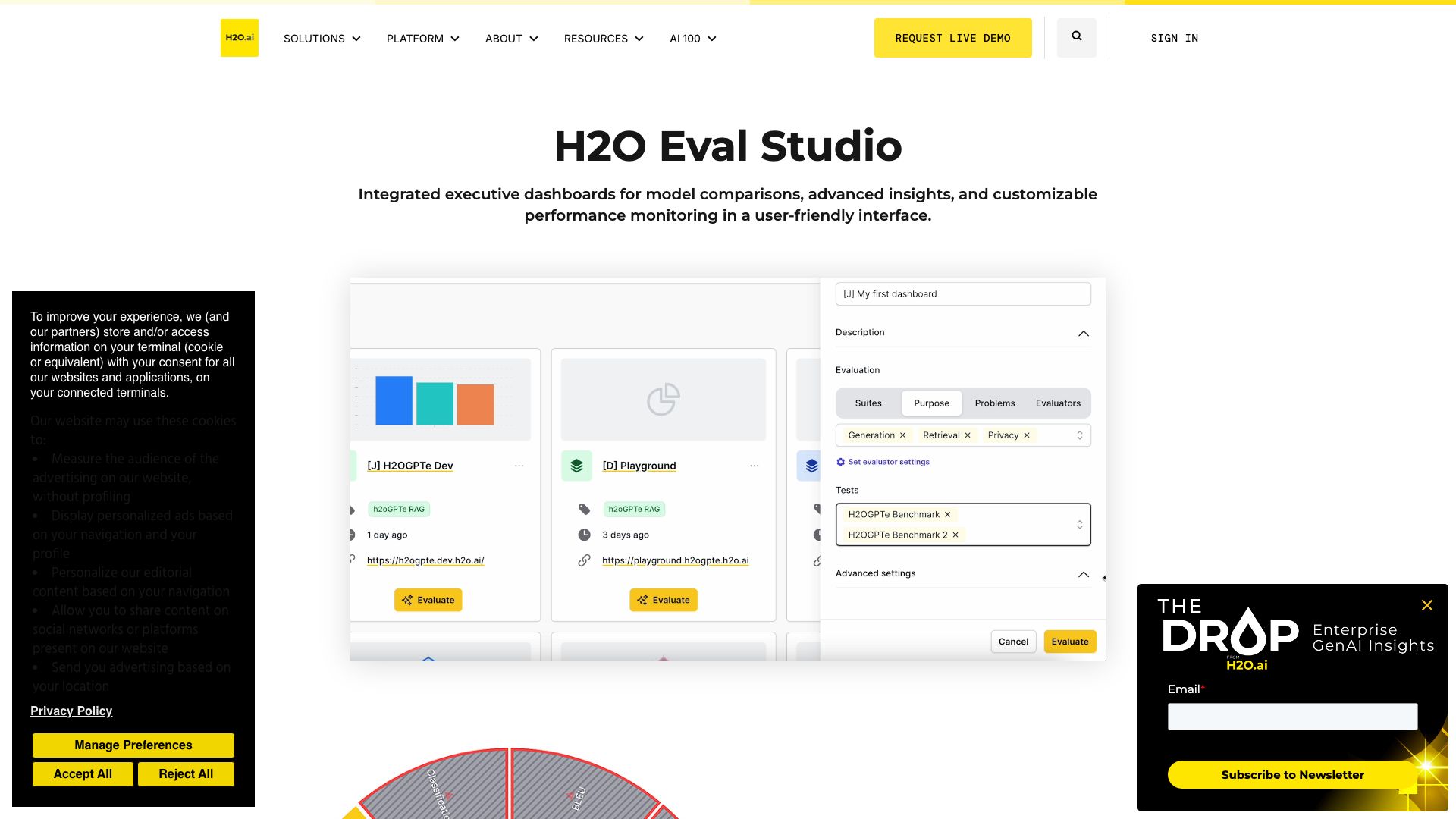

产品截图

详细介绍

产品概述

H2O Eval Studio 是 H2O.ai 推出的模块化评估工作室,专为检验 Retrieval‑Augmented Generation(RAG)和大语言模型(LLM)在性能、可靠性与安全性方面的表现而设计。目标用户包括 AI 研发团队、产品经理、企业技术负责人等,帮助其在上线前获得可信、可解释的评估结果。

核心功能与特点

- Eval Eye executive dashboards:统一仪表盘展示多模型、多评估指标(如幻觉、忠实度、偏见、RAGAS 分数),支持实时监控。

- 模型与排行榜对比:一键比较不同系统的评估结果,快速识别最优模型。

- 可配置评估器 & 参数覆盖:灵活设置模型参数、评估规则与自定义覆盖,满足业务特定需求。

- 高级评估洞察:自动捕获失败状态、提供问题根因分析。

- 测试用例扰动:通过扰动测试集检验模型在噪声、变体等场景下的鲁棒性。

- 用户友好界面:改进的列表页、可视化图表与整体 UI,降低使用门槛。

- 企业级安全与稳定性:后端强化安全、容错与高可用,保障评估数据安全。

优势

- 端到端可视化:相比传统脚本化评估,提供统一的可视化视图,提升决策效率。

- 多评估同时运行:支持并行执行多个评估套件,节省时间并提供全局洞察。

- 深度可信度检查:专注于幻觉、忠实度与偏见等 Trustworthy AI 关键指标,帮助企业合规。

- 高度可定制:参数覆盖与自定义评估器让不同业务场景均能精准对齐。

- 与 H2O 生态集成:可直接对接 H2O Driverless AI、H2O LLM Studio 等产品,实现模型全链路管理。

应用场景

- 企业 GenAI 产品监控:在金融、医疗、客服等行业实时监控生成式 AI 的输出质量与合规性。

- 模型选型与调优:研发阶段对比多种 LLM、RAG 配置,快速定位最佳模型。

- 合规审计:输出报告用于内部审计或监管机构检查,验证模型无偏见与幻觉风险。

- 跨团队协作:产品、研发与运营共享统一仪表盘,统一评估标准,提升沟通效率。

- 教学与培训:在 AI 课程或企业内部培训中演示模型评估全过程,提升团队 AI 可信度意识。

相关工具

AI分享圈

AI分享圈是一个专注于聚合与分享免费AI工具、模型及学习资源的导航网站。其核心价值在于为AI学习者与从业者提供了一个集中、便捷的免费资源入口,旨在帮助用户从入门到精通人工智能技术。

PromptPilot

PromptPilot是一款面向大模型应用的全链路优化平台,提供从Prompt生成、调试到基于真实反馈数据智能调优的一站式服务,旨在构建可自我进化的大模型应用,加速AI能力在业务场景中的落地。

66论文

66论文是一个专注于学术写作的AI辅助平台,集成了DeepSeek等先进模型,旨在为学生、教师及研究人员提供从选题、大纲生成到全文撰写的一站式论文写作解决方案,强调高质量、低查重率与真实参考文献支持。

Ollama

Ollama 是一个简化使用开源大模型进行工作自动化的平台,支持从本地部署无缝扩展到云端高性能模型,并承诺用户数据安全和隐私保护。